李水青 智东西 2024年07月04日 14:29 北京

作者 | 李水青 香草

编辑 | 云鹏

智东西7月4日报道,今天上午,2024世界人工智能大会(WAIC)在上海开幕!作为国内最高规格的AI领域行业大会之一,WAIC 2024开幕主论坛不仅有高层参与,同时汇聚了众多产学研领域大佬。

开幕式请到了三大图灵奖得主姚期智、罗杰·瑞迪(Raj Reddy)和曼纽尔·布卢姆(Manuel Blum)共同进行圆桌论坛交锋,原微软执行副总裁、美国国家工程院外籍院士沈向洋担任圆桌主持人。

更有IEEE主席托马斯·考夫林(Thomas Coughlin),清华大学苏世民书院院长、清华大学人工智能国际治理硏究院院长薛澜,上海人工智能实验室主任兼首席科学家、清华大学惠妍讲席教授周伯文,新思科技总裁兼首席执行官盖思新(Sassine Ghazi)等重磅大咖演讲。

开幕式上,沈向洋向三位图灵奖抛出了关于“AI发展及风险”、“有意识的AI”、“AI教育和人才培养”等众多产学研关注的问题。

图灵奖得主罗杰·瑞迪谈道,AI风险确实应该得到高度关注,同时我们也不能因噎废食。同时他认为当下的教育体系没法培养了解AI的未来一代人。如果AI让每个人的工作效率提升10倍,全球GDP将从100万亿美元增长到1000万亿美元。

图灵奖得主曼纽尔·布卢姆解读了其团队意识图灵机(CTM)成果,1000万个处理器都是类似于意识模型,没有一个中央决策者,而是让每一个处理器参与决策。

图灵奖得主姚期智谈及了AI发展的网络、社会和生存三大方面的风险,认为AI的风险比核问题更严峻,我们创造了比我们强大很多倍的新物种,需要探讨如何用AI控制AI避免重大破坏。

同样谈及AI治理的重要议题,薛澜谈道,巨量的基础设施已经使得全球25亿人受益,但AI发展仍面临AI技术鸿沟、治理鸿沟,阻碍全球AI的发展,需要多方一起攻克。

此外,黑石集团董事长、首席执行宫兼联合创始人苏世民(Stephen A. Schwarzman),索奈顾问及投资公司董事长、首席执行官乔舒亚·雷默(Joshua Ramo)也做了精彩分享。

此次WAIC 2024展览面积超5.2万平方米,共有500余家企业参展,展品数量超1500项,覆盖核心技术、智能终端、应用赋能等三大板块。

大会还公布了“镇馆之宝”名单,商汤科技首个面向C端用户的可控人物视频生成大模型Vimi、阿里云A编程助手通义灵码、支付宝智能助理、智谱A基座大模型、特斯拉赛博越野旅行车等入选。

01.

沈向洋对话三大图灵奖得主:

AI风险比核更严峻,但不能因噎废食

在开幕式上,三位图灵奖得主罗杰·瑞迪、曼纽尔·布卢姆和姚期智进行了精彩的圆桌对话,原微软执行副总裁、美国国家工程院外籍院士沈向洋担任主持人。

沈向洋向三位图灵奖得主提出了多个问题,包括:如何看待AI发展及担忧?为什么我们紧迫关注AI治理问题?如何看待有意识的AI等等。

1、灵奖得主罗杰·瑞迪:教育体系落后于AI时代,发展AI不能因噎废食

罗杰在当年获得图灵奖时就提到要建立大型AI系统,他在圆桌中谈道,很开心看到会场大家对AI治理和风险的探讨,没有只是去探讨怎么去用AI。大家没有花太多时间,探讨我们如何来用AI,需要做哪些研究和投资?我们现在还没做到这一点。

在能力建设方面,罗杰认为,目前我们的教育体系没办法培养未来了解AI的一代人,他们需要用AI做好自己的工作,我们怎么让每个人把自己的工作做好?这个问题很关键。

谈及接下来推进的研究,罗杰谈道,每个领域都会出现新机会,也会出现新问题,比如汽车刚出现时,为人们出行带来便利,但交通事故也带来很多伤亡。因此对于AI我们也不能因噎废食。

每个工程师都能做更好的事,如何让他们效率更高?这意味着要做很多投资和研究工作,我希望不要只想着负面,要想着未来的机会很多。他觉得最大的机会,以后每个人的工作效率会提升10倍,全球GDP将从100万亿到1000万亿美元。

2、图灵奖得主曼纽尔·布卢姆:解读图灵机CTM意识模型,模拟人脑决策

曼纽尔在现场解读了有意识的AI。他谈道,年少时他的父亲曾告诉他:“如果你知道你的这个大脑里在发生什么,那么你就会变得更加聪明一些。”很幸运,他的工作是跟意识有关的。意识可以给我们想法,让我们去建立AGI。

曼纽尔的团队已经创立了一个意识模型——图灵机CTM,以此向大家解释大脑里在发生什么。如果我们将大脑里发生的事情想成一个剧场,有一些演讲者在剧场中央讲话,我们可以让很多处理器同时工作,相当于大脑里的神经元,这些处理器会听现场发生了什么,告诉我们怎么去做各种各样的事情。

CTM意识模型特别有意思,1000万个处理器都是类似于意识模型,没有一个中央决策者,而是让每一个处理器参与决策。

曼纽尔的学生众多学生也拿到了图灵奖,当沈向洋问及他有什么为师之道?曼纽尔谦虚地称:“我的学生都比我聪明,我从他们身上学到了很多。有时候我不懂什么,我就直接说我不懂。”

3、图灵奖得主姚期智:AI治理警惕三大风险,比核风险更严峻

姚期智谈及的自己对AI治理的关注,从风险方面讲解到自己作为计算机科学家对AI治理的见解。

他认为,AI风险主要来自三个方面:(1)它是网络风险的延伸和扩大,AI能力的出现使得传统的网络风险被放大。我们已经觉得管理数据很困难,现在难度会放大100倍。(2)社会风险,人们可以用很多方式使用强大的AI,可能对某些领域带来颠覆式风险,也可能带来新的失业问题。(3)生存和存在的风险,AI风向相比于核风险可能更严峻,这都需要很多的专家来一起解决,包括科学家、政府人士、律师及经济学家都需要参与进来。

从计算机科学教角度,姚期智更关注第一类和第三类风险。

面对第一类风险,AI有时无法解释一些问题,使得研究新的密码学比较困难,我们对网络风险的应对还处在很早的阶段。

而面向第三类风险,这个和计算性有关,更大的算力可以带来更多的知识和智慧,解决很多以前解决不了的问题,这也是让人很恐惧的。现在,我们就是突然发现了一个方式,能创造比我们强大很多倍的新物种,我们需要确定能不能与它共存。

所以作为计算机科学家,姚期智看到最有深度的问题,就是我们怎么把AI控制好,避免它带来重大破坏,这是很难预测的。

02.

清华大学苏世民书院院长薛澜:

降低AI风险,缩小全球AI技术鸿沟

清华大学苏世民书院院长、清华大学人工智能国际治理硏究院院长薛澜探讨了AI治理的重要议题。

AI能为我们做什么?薛澜谈道,大家对AI给予了很高的期望,根据SDG(可持续发展目标)最新分析,AI总体来看会对可持续发展的134个(79%)具体目标产生促进作用,对59个(35%)目标产生阻碍作用。

AI对这些目标的阻碍作用,代表AI可能带来风险。这些风险包括基于技术本身的风险、基于技术开发的风险和基于技术应用/滥用的风险等多个方面,都是不可忽视的。

如何推动AI收益最大化、风险降到最低?

薛澜谈道,首先在底层,我国在产业应用安全方面推出了一系列法律法规,推动AI的合理发展。我们针对算法、算力、数据推出了一系列的治理规则,针对风险推出了一系列准则。针对一些专项问题,包括具体场景的应用,我们也出台了相应的一些治理规则。此外,我国也在采取措施推动全民数字素养的提升。

从全球角度来讲,AI发展也还面临很多挑战。一方面,巨量的基础设施已经使得25亿人受益,但AI发展仍面临技术鸿沟、治理鸿沟,阻碍全球AI的发展。当今社会,一个国家带来的风险就是全球风险。国际对安全问题日益重视,同时对AI数智鸿沟关注仍不够,需要全球社会一起努力攻克。

03.

上海AI实验室周伯文:

AI性能与安全失衡,99%算力用在预训练

以大模型为代表的深层次AI快速发展,也带来数据泄露、虚假信息、伦理问题等一系列风险、社会挑战,如何建立一个全面的AI安全治理体系,成为全球范围内的优先议题。

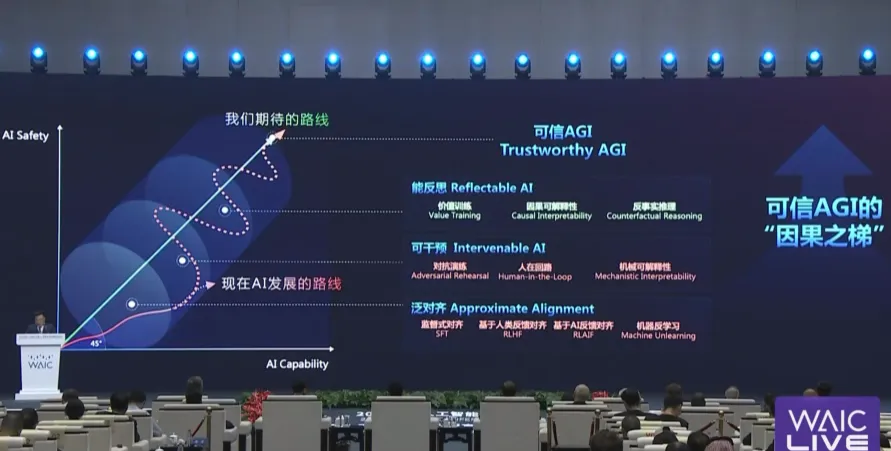

为此,上海人工智能实验室主任、首席科学家、清华大学慧妍讲席教授周伯文提出了一个新的技术主张——AI的45度平衡律。

这一定律指的是,从长期视角来看,AI安全与性能要大体沿着45度的路线平衡发展。

现在AI发展的路线整体是低于45度的,也就是性能发展快于安全治理,也就带来了各种风险;而如果长期高于45度,则会阻碍技术和产业应用的发展。如何找到两者之间的平衡,是亟待解决的难题。

为了实现这一定律,上海人工智能实验室提出了一条以因果为核心的路径,即可信AGI的“因果之梯”。这一路径将可信AGI的发展划分为三个递进阶段,从“泛对齐”,到“可干预”,再到“能反思”。

“泛对齐”包含当前最前沿的人类偏好技术,如机器反学习、监管式对齐、基于人类反馈对齐等。这些对齐技术目前仅依赖统一的相关性而非真正的因果关系,因此可能导致错误的推理和潜在危险。

“可干预”是第二层AI对齐技术,包含AI系统的对抗训练、机械可解释性等,其通过高可解释性和泛化性来提高安全性能,同时也提升AI能力。

“能反思”则要求AI系统不仅要追求高效的执行任务,还要审视自身行为的外在影响和潜在风险,从而保证在高性能的前提下安全和道德边界不被突破。这个阶段的技术包括基于价值的训练、因果可解释性、反事实推理等。

周伯文谈道,目前全球AI安全和性能技术发展主要停留在第一阶段,一部分开发者在尝试第二阶段。但要真正实现AI的安全与性能平衡,必须完善第二阶段,并勇于攀登第三阶段。

最后,他呼吁全球开发者加强国际合作,这对于推动AI技术健康发展至关重要,我们的共同目标是构建一个开放安全的AI创新生态系统和人才培养环境。

04.

新思科技CEO盖思新:

能耗减少30%,缓解人才紧缺

新思科技总裁兼首席执行官盖思新认为,从商业和企业的角度来看,我们要了解AI产业链是从半导体开始的,同时也离不开上层软件。

回顾半导体行业历史,行业花了60年才实现5000亿美元的销售额,2020年翻了1倍到1万亿美元,几乎所有的这些增量都是由AI的增长所驱动的。

AI是一个非常大的转折点。盖思新谈道,新思公司为此提供软件,帮工程师使用复杂的半导体芯片,尽可能用软件实现自动化。AI能帮我们改进芯片开发的过程,从而实现更快的速度,在各方面实现优化。

“我们在AI上面有很多共同的原则。”包括政府合规问题,芯片中每个部分的材料都要保证安全,确保芯片没有不合规成分且监管高效。同时,如何使得半导体能耗消耗更高效,也是我们在半导体设计中需要考虑的问题。

新思科技有2万多名工程师,如何用AI来助力业务?

新思科技创办了一个AI卓越中心,以此教育自己的工作人员,让他们知道AI的价值、伦理及风险等,并帮他们教育客户来使用AI来开发芯片。

同时,新思科技也对AI进行商业化,2017年开始就在投资AI,在提供客户的方案里涉及AI,目前也已经包含很多生成式AI内容,比如用用生成式AI作为知识基础,提升工程师的效率,缓解工程师人才紧缺问题,从而提高整个行业的工作效率。

在耗能方面,基于AI技术服务,能耗减少30%,涉及更复杂的问题时效率还能增长15倍。

05.

全球治理高端对话:

拥抱新技术,建立学术界新扶持方式

AI的快速发展,对企业运营模式、价值评估以及投资决策过程也产生了深远影响,深刻改变了投资格局。

黑石集团董事长、首席执行官兼联合创始人苏世民与索奈顾问及投资公司董事长、首席执行官乔舒亚·雷默就这一系列问题,展开了全球治理高端对话。

从商业的角度来看,AI是怎么改变一家企业现有的价值认定的?

苏世民谈道,自己在刚入行的时候并不擅长做模型,而现在出现了新的AI应用,可以帮助自己起草会议备忘录等,带来了很多惊喜。

在他看来,虽然对新的技术仍需保持一定警惕性,但不能“像鸵鸟一样把头埋在沙子里”充耳不闻,也不能完全不关注技术风险。

在AI领域中,苏世民是在学术研究方面慈善捐赠规模最大的人之一。当雷默问及为什么突然选择AI这个领域时,苏世民有些感慨地回答:“我想并不是我选择了AI,而是AI选择了我。”

早些时候,他曾作为投资新人资助了牛津大学的一个AI伦理运营项目。之所以这么做,是因为当时每个人都涌向纯理科投资的时候,他觉得需要将理科研究和人类情感上的一些事情相结合,去进行思考和研究,因为“这将会影响和改变人类未来10-20年之后的一些行为”。

同时他也十分关注监管方面的项目,在他看来,从事硬核技术、理科技术的人,在有可能出错的地方应心存敬畏。

相比于商业界,高校等学术机构现在在AI竞争方面处于劣势,一些突破性的进展大多出现在商业领域。这是算力等开发成本所导致的结构性变化。苏世民谈道,随着AI的持续发展,必须对学术界建立一种更有价值的扶持方式,要做一些比仅仅资助一位教授的研究项目来说,更有意义的事情。

06.

结语:生成式AI狂飙,

风险管控成为重要议题

在去年的WAIC上,产学研大佬们畅谈大模型浪潮,对下一阶段发展方向、应用爆发领域展开深入探讨和积极展望。

而到了今年,AI风险与安全已成为最受关注的话题之一,无论是性能与安全的平衡,还是教育体系的落后,都是全球范围内共同探讨的重要议题。

总的来看,AGI仍是科技行业共同期待的目标。我们期待看到各行各业能在安全可信的指导下,为AGI的发展注入新的生命力。

本文作者可以追加内容哦 !