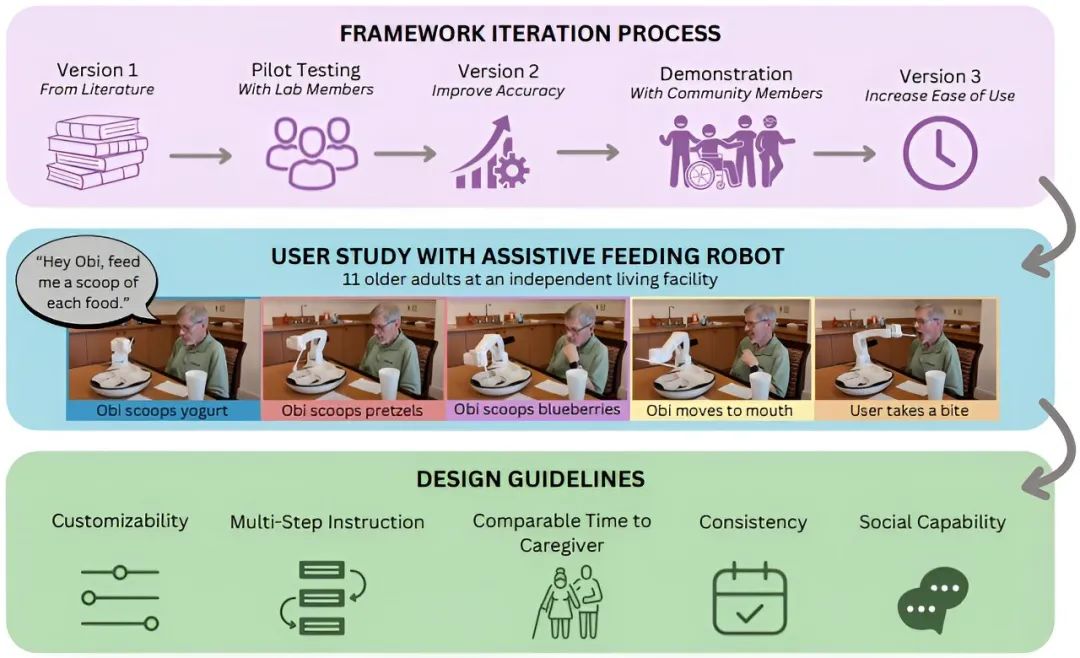

近年来,LLMs以其强大的自然语言处理能力和知识推理能力,逐渐成为推动人工智能技术进步的重要驱动力。尤其是在机器人领域,LLMs应用不仅提升了机器人的智能化水平,还更多地拓展了落地应用场景。近日卡内基梅隆大学采用VoicePilot框架通过LLMs嵌入辅助喂食机器人,以此来提升机器人的人机交互能力。VoicePilot论文已被用户界面软件和技术研讨会 ( UIST 2024 )接受发表,该研讨会将于 10 月在匹兹堡举行。

LLMs在机器人语音接口中的应用

LLMs,即大语言模型,是自然语言处理领域的一项关键技术。它通过深度学习技术,对大量文本数据进行训练,从而具备生成高质量文本、理解自然语言意图和进行知识推理的能力。目前主流的LLMs包括OpenAI的GPT系列、Google的BERT等。这些模型不仅在文本生成、问答系统、情感分析等方面表现优异,还在机器人控制、任务规划等领域展现出巨大潜力。

喂食机器人作为一种辅助设备,主要服务于因身体残疾或老年化而无法独立进食的人群。传统的喂食机器人通常依赖预设程序或简单的按钮操作,难以满足用户的个性化需求。因此,如何让喂食机器人能够提供差异化服务,就需要研究人员开发一种基于语音的交互接口,使用户能够通过自然语言指令控制机器人。

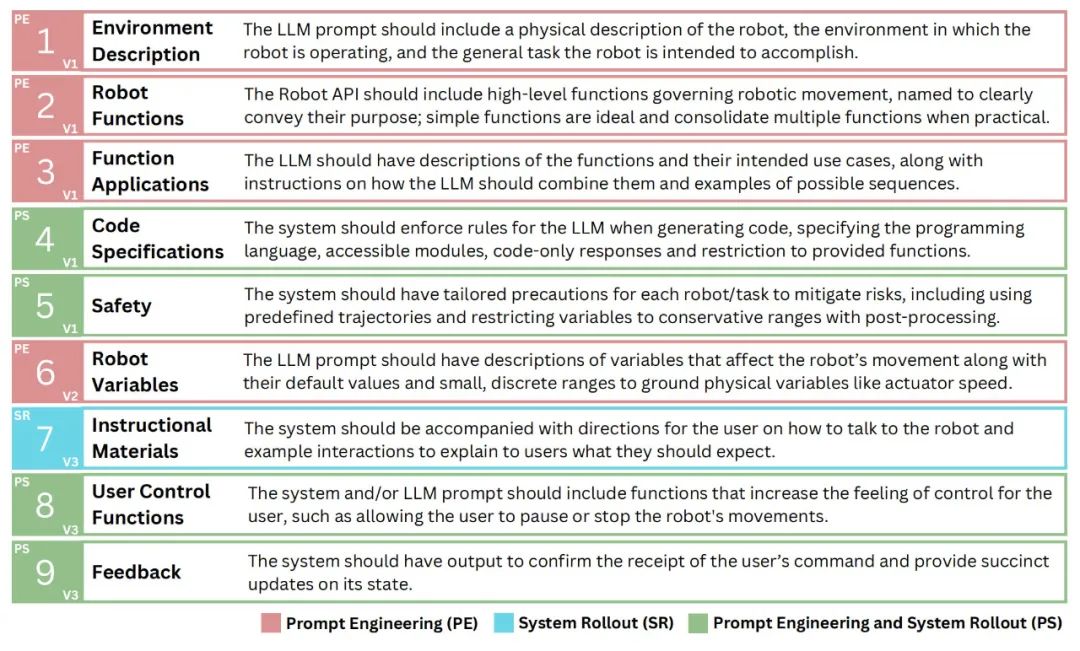

VoicePilot框架由9个组件构成

研究人员表示,目前基于LLMs的机器人能够理解复杂的自然语言指令,同时能够根据用户的上下文信息生成相应的响应,提高交互的连贯性和准确性,此外LLMs还具有一定的知识推理能力,能够在一定程度上理解用户的意图和需求,这对于用户的个性化服务非常重要。

在喂食机器人的语音接口实现中,研究团队集成了先进的LLMs,使其能够理解用户的自然语言指令。用户通过麦克风发出语音命令,这些命令首先被转换为文本,随后送入LLMs进行解析。LLMs不仅识别出用户的意图,还根据指令中的参数生成相应的控制代码。这些代码被发送给喂食机器人的控制系统,驱动机械臂执行喂食动作,如从碗中舀取食物并准确送至用户嘴边。同时,机器人通过语音或视觉方式实时反馈执行状态,与用户形成流畅的自然交互体验。

LLMs在喂食机器人语音接口中的技术创新

研究人员表示,LLMs能够处理和理解复杂的自然语言指令。与传统的关键词识别系统不同,LLMs能够解析用户发出的自然、流畅的语音命令,这些命令不仅包含了简单的操作指令,还包括更细致的参数设置,如食物的量、喂食的速度等。这种能力使得喂食机器人能够更贴近用户的实际需求。

9位受试者参与实验

此外传统的语音接口往往依赖于预设的脚本或模板来生成控制命令,而LLMs则能够根据用户的指令动态生成相应的代码。这意味着喂食机器人能够执行的任务范围得到了极大地扩展,不再局限于预设的动作集合,而是能够根据用户的即时需求进行调整和优化。

值得一提的是LLMs的引入还提升了喂食机器人的适应性和鲁棒性。在实际测试中,用户的语音指令可能存在模糊、歧义或错误的情况。而LLMs通过其强大的语义理解和上下文分析能力,能够在一定程度上容忍这些不完美因素,从而提供更加稳定和可靠的交互体验。同时,LLMs还能够通过持续地学习和优化来不断提升其性能,进一步增强了喂食机器人的适应性和智能化水平。

结语与未来:

研究人员表示,VoicePilot框架强调了用户的差异化需求,通过多次迭代与优化,不断提升喂食机器人的系统性能与用户体验。随着LLMs技术的不断进步,结合VoicePilot框架的迭代优化机制,喂食机器人将能够更准确地执行复杂任务,满足用户的多样化需求。

在用户的数据安全和隐私方面,VoicePilot框架可以通过集成先进的数据加密和隐私保护技术,确保用户信息的安全性。同时,框架还可以支持灵活的模块化设计,使得机器人系统能够根据不同应用场景进行定制化配置,从而在成本控制和市场普及方面取得更大突破。

整体来看,通过研究人员的综合评估,VoicePilot框架在喂食机器人结合LLMs语音接口技术当中发挥了更加积极的作用,并且能够为用户提供更加便捷、高效、个性化的喂食解决方案。研究人员表示,下一步团队将评估如何降低喂食机器人的成本,提升市场普及能力,为商业化落地做准备。

本文作者可以追加内容哦 !