你限制我,我也能出手反制。

12月初,全球两大经济体的博弈正式开始。本月初拜登政府公布了对我国获取芯片和人工智能(AI)关键部件进行了限制措施,其目的已经相当明显;而我国也未手软,给出了对应的反制政策,先是对芯片等重要高端制造业的原材料进行出口限制;接着对全球GPU龙头在我国的资本运作展开了反垄断调查。

12月9日晚间,我国国家市场监管总局发布消息称:英伟达(NVDA.O)涉嫌违反《中华人民共和国反垄断法》及《市场监管总局关于附加限制性条件批准英伟达公司收购迈络思科技有限公司股权案反垄断审查决定的公告》(市场监管总局公告〔2020〕第16号),市场监管总局依法对英伟达公司开展立案调查。而该事件也导致英伟达股价出现大幅波动,12月9日至12月16日,英伟达股价区间累计跌幅超过7%,市值蒸发1700多亿美元。

然而另一边,有一家全球领先的有线和无线通信的半导体公司却异军突起,在美东时间上周五的最后一个交易日(12月13日),这家美股上市公司市值大涨,并迅速突破万亿美元大关,成功加入“万亿俱乐部”。而截止当天收盘,博通(AVGO.O)股价报收224.8美元/股,涨幅达到24.43%,总市值来到了1.05万亿美金,是继微软、苹果、英伟达等9家公司之后,又一家市值超万亿美金的上市公司。而且博通的市值还在增长,本周一博通继续跳开走高,报收250美元/股,市值达到1.168万亿美元,涨幅达到11.21%。即使经历昨晚美股大跌,博通市值依旧在万亿美元之上。

英伟达地位不稳?

在ASIC业务暴涨的博通,与深陷全球反垄断风波的GPU龙头英伟达相遇。或许意味着全球AI芯片的竞争格局将在不久后出现大变天!英伟达“独步江湖”的龙头地位能否被挑战?

01 博通凭什么挑战英伟达

首先简单回顾下近期英伟达的“反垄断调查风波”以及博通的技术突破。

我国对英伟达的反垄断调查主要是针对5年前英伟达的收购动作,即2019年3月,英伟达宣布以69亿美元(约合人民币500亿元)的价格,收购美股上市公司迈络思。而由于交易金额及在华收入占比等因素,该收购需要我国反垄断机构的批准。经过一年多的审查后,我国国家市场监管总局认为,这项收购对全球和中国GPU加速器、专用网络互联设备和高速以太网适配器市场,具有或者可能具有排除、限制竞争效果,因此决定附加限制性条件批准此项经营者集中,从法律层面来看,我国这次对英伟达立案调查是有理有据。

而惩罚措施大概率是罚款,是按照上一年度销售额的百分之十以下。按照去年全年即2024财年(截至今年1月底),英伟达在我国的营收是103.1亿美元,按照这个数据计算,英伟达可能面临1.03亿-10.3亿美元的罚款,若情节恶劣、影响严重,或将面临最高50亿美金的罚款。关键对英伟达的反垄断调查并非只有我国。法国反垄断机构、欧盟,甚至美国自己也对其开展过反垄断调查。

至于对英伟达的影响,目前看并不算大,按营收比例交罚金是主要惩罚手段。然而从英伟达的业绩增长来看,全球对高端GPU的需求依旧不减。2025财年Q3的业绩依旧抢眼,其中数据中心业务收入达308亿美元,环比增长17%,同比增长112%且创历史新高。即使被反垄断调查,但业绩表明英伟达的人工智能芯片依旧受到微软、谷歌、Meta等客户的高需求,可见短期在全球AI算力芯片的供给层面,英伟达依旧一家独大,各国企业都无可奈何。

然而,就在上周博通的ASIC芯片业务暴涨似乎给了行业一道“曙光”。

美东时间12月12日,博通发布了2024财年公司的业绩情况,其中最让市场振奋的是博通高速增长的AI板块,其收入增长220%,达到122亿美元。而且根据公司透露,目前正在与三个大型客户开发AI芯片,预计明年公司AI芯片的市场规模将达到150-200亿美元,即增长23-64%。虽然预期增速并不太强烈,但从博通业绩预期的变化已经给市场传递出一个明显的信号:厂商对于专用芯片的需求量激增,AI芯片市场竞争局面正在发生着巨变!

在AI领域,博通主要从事定制或专用集成电路(ASIC)和以太网网络部件的业务。而ASIC(全称为Application Specific Integrated Circuit,专用集成电路),其核心壁垒在于其独特的定制化特性,可以在特定领域展现出了无可比拟的优势。而ASIC芯片,顾名思义,就是针对特定应用需求而设计的芯片。与通用芯片(以GPU为代表)相比,ASIC芯片在性能、功耗和成本等方面具有显著优势。并且相较于性能端,能够针对特定算法和应用场景进行优化,从而实现较高的计算效率和更低的功耗。

目前市场的普遍预期其是自研ASIC芯片逐渐替代英伟达AI GPU芯片,而博通的市值大涨被视为ASIC芯片反攻GPU阵营的一个前奏,未来自研ASIC芯片将与英伟达GPU共享AI算力芯片市场,而AI GPU和ASIC之争更像是一场通用和专用阵营之争。然而事实上在AI最终定型之前,两种芯片绝不会完全取代对方,这场博弈也不一定以一输一赢为结果。

02 ASIC芯片对比英伟达AI GPU

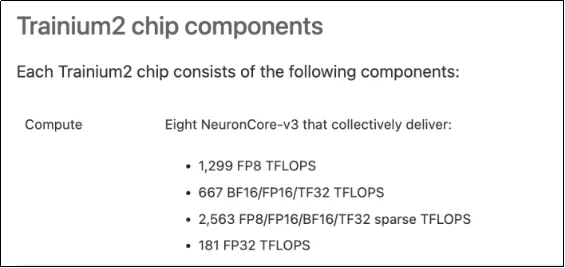

ASIC阵营中主要参考的是最近在市场上很火的,由亚马逊云科技(AWS)自研的Trainium 2芯片,下面简称T2芯片;而根据近期亚马逊AI高管的调研来看,其对标的是英伟达的H100算力芯片。虽然英伟达已经推出了H200、H800甚至是Blackwell架构的B100和B200,然而从算力芯片的应用场景来看,T2的核心场景是“大规模AI训练和推理”,与目前英伟达H100芯片的应用场景相似,因此这里拿H100芯片来对比,毕竟最先进不代表最适合。

从算力参数来看,T2的BF16计算能力达到了667 TFLOP/s,同时功耗在500W,而H100的 BF16计算能力为989 TFLOP/s(官网数据),功耗在700W,这里可以得到一个每W功耗下的算力,T2为1.334 TFLOPS/W,H100为1.413 TFLOPS/W。可见,虽然单位功耗算力情况T2已经很接近H100,但依旧处于落后。不过这里还要考虑成本。虽然T2的价格并未透露,但根据亚马逊AI高管透露:芯片T2的设计目标是比英伟达的产品便宜约40%,而按照英伟达H100售价在3万-3.5万美元左右,即T2的价格大约是在1.8万-2.1万美元。

而加入价格因素后(取下限),可以得到每10000美元可以买到的单位功耗算力分别为0.74 TFLOPS/W和0.47 TFLOPS/W,在电价相同的情况下,AWS的T2能节省大约42.6%的成本。这个百分百基本也对应了大摩近期给出的研报,其中:摩根士丹利通过TCO模型对比了ASIC和GPU在AI训练和推理任务中的成本效益。结果显示,尽管英伟达的GPU在性能上占据明显优势,但ASIC的初始成本较低,尤其适合预算有限的云服务提供商。比如在同等预算下,AWS的T22可以比英伟达的H100 GPU更快速完成推理任务,且性价比提高了30-40%。

从上面的分析来看,基本上T2在“大规模AI训练和推理”场景下作为替代2022年英伟达推出的H100是可以达到的,而且成本优势还是很明显。当然有人会质疑说,前面只对比了BF16的计算能力,除了张量计算核心,GPU还有其他的CUDA核心,比如FP64这些。那是自然,毕竟T2作为ASIC芯片,主攻的就是大模型AI训练和推理,也仅能在某一算力需求领域行得通,主打就是一个超级“偏科”,就好比你让苏神参加奥运会的“十项全能”比赛,估计除了短跑,其他基本没戏。

总结来看,AI GPU和ASIC芯片目前优缺点都比较明显。AI GPU优势在于通用,能适用于运行诸多算法,且英伟达CUDA生态成熟,易用性较强;缺点在于通用GPU存在算力过剩、功耗和成本较高的弊端。而ASIC芯片相对定制化,针对特定算法和AI场景的设计使算力和功耗表现可能更优。这里大摩也提到过:英伟达依旧独步江湖,毕竟除了硬件,英伟达还有更成熟的系统集成能力和更强大的软件生态,这能让公司在TCO计算中依旧保持较高的竞争壁垒,尤其是在需要灵活应对不同AI任务的场景中。

那发展ASIC芯片的意义大吗?

意义那是相当的大!今年年初,根据美国富国银行的统计,英伟达在数据中心AI算力市场的市场份额高达98%,而AMD仅有1.2%的市场份额,英特尔则只有不到1%,这里数据有一定出入,也有统计在90%以上。不过从微观经济学角度来说,市场份额在50%以上就已经可以被定义为“垄断市场”了。随着AI算力需求的不断增长,市场对于AI芯片的需求水涨船高,而ASIC芯片高速发展给予了厂商除英伟达AI GPU外的其他选择,更关键的是ASIC芯片更大的和任务是打破英伟达一家独大的定价权!

本文作者可以追加内容哦 !