高楼万丈从地起。

归根到底。

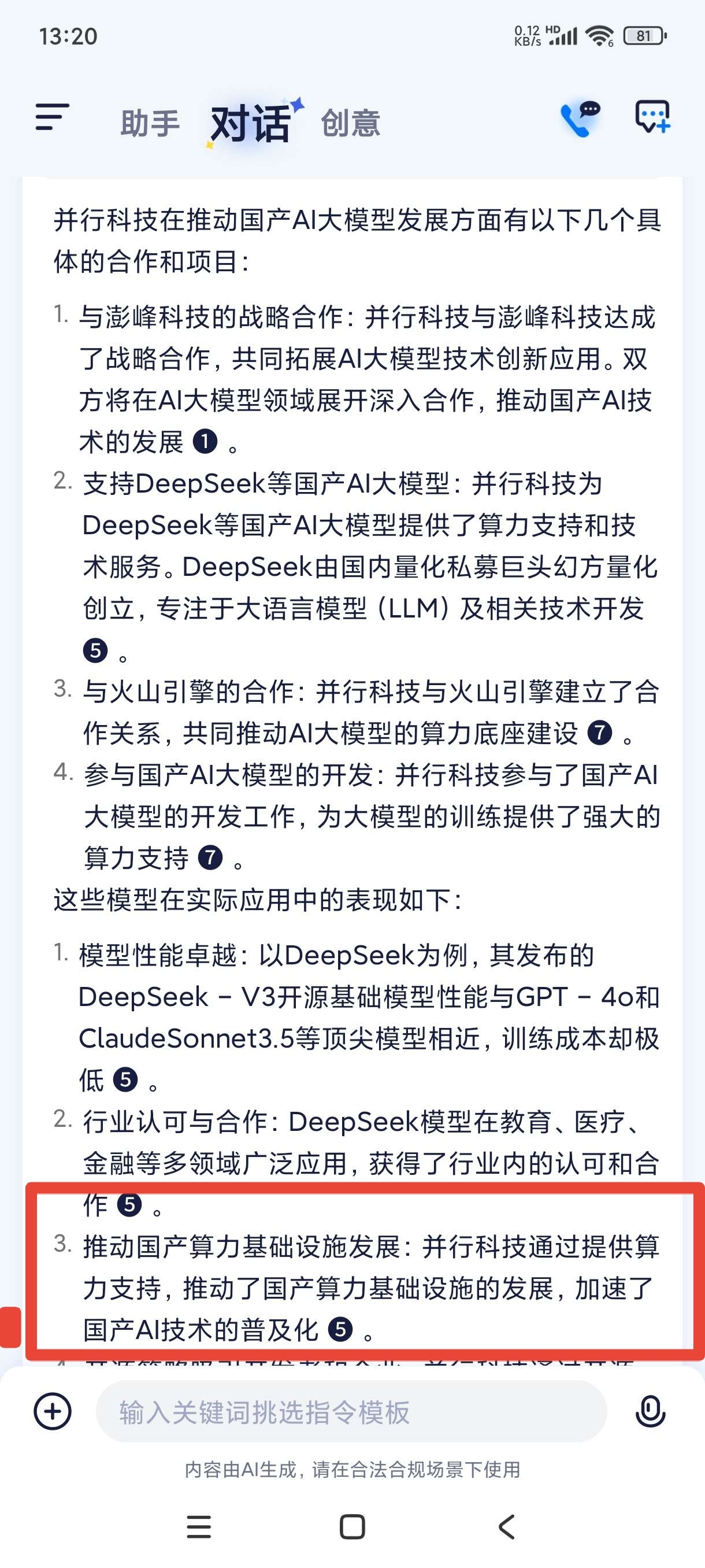

算力基础设施的建设。

仍然还是关键的因素!!!

而且!!!!

deepsee只是大模型里面的一朵小浪花!!!!!!

更多的大模型还在路上。。。。。。![色 [色]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot16.png)

![色 [色]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot16.png)

![色 [色]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot16.png)

![加油 [加油]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot12.png)

![加油 [加油]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot12.png)

![加油 [加油]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot12.png)

![强壮 [强壮]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot59.png)

并且新发布模型当中,文字和图片视频的处理。

需要算力的等级那是远远不一样的!![滴汗 [滴汗]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot7.png)

![捂脸 [捂脸]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot42.png)

另外目前低端的只是够用吧!![滴汗 [滴汗]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot7.png)

![滴汗 [滴汗]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot7.png)

![滴汗 [滴汗]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot7.png)

如果只局限于回答问题的软件够用了。

未来AI技术运用到医疗、军事、外太空等领域你觉得这点够嘛?!![为什么 [为什么]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot4.png)

![滴汗 [滴汗]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot7.png)

![滴汗 [滴汗]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot7.png)

![滴汗 [滴汗]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot7.png)

![捂脸 [捂脸]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot42.png)

![捂脸 [捂脸]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot42.png)

![捂脸 [捂脸]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot42.png)

而且,

如果平民化的AI应用到来,说明会有更多的公司加入进来分果实!

而不是现在只有大公司才玩得起,那算力将会更大程度爆发。![色 [色]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot16.png)

![色 [色]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot16.png)

![色 [色]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot16.png)

![加油 [加油]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot12.png)

![加油 [加油]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot12.png)

![加油 [加油]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot12.png)

![笑哭 [笑哭]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot39.png)

![笑哭 [笑哭]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot39.png)

![笑哭 [笑哭]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot39.png)

逻辑要搞清楚 !!!![捂脸 [捂脸]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot42.png)

![捂脸 [捂脸]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot42.png)

![捂脸 [捂脸]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot42.png)

![笑哭 [笑哭]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot39.png)

今后的各行各业(医、教、工、农、商、美术、传媒、文化艺术、科研、手工制作。。。。。。等等)全方位Al人工智能的普及化!平民化(关键词)!!!!![滴汗 [滴汗]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot7.png)

![滴汗 [滴汗]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot7.png)

![滴汗 [滴汗]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot7.png)

![捂脸 [捂脸]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot42.png)

![捂脸 [捂脸]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot42.png)

![捂脸 [捂脸]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot42.png)

将是未来的大趋势!!!!![色 [色]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot16.png)

![色 [色]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot16.png)

![色 [色]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot16.png)

![笑哭 [笑哭]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot39.png)

![笑哭 [笑哭]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot39.png)

![笑哭 [笑哭]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot39.png)

![加油 [加油]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot12.png)

![加油 [加油]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot12.png)

![加油 [加油]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot12.png)

![强壮 [强壮]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot59.png)

![强壮 [强壮]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot59.png)

![强壮 [强壮]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot59.png)

所以,

算力需求绝对值的数量。

也必然会增加!![色 [色]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot16.png)

![色 [色]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot16.png)

![色 [色]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot16.png)

仅仅只是性价比会比美国佬的高很多很多!![色 [色]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot16.png)

![笑哭 [笑哭]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot39.png)

![笑哭 [笑哭]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot39.png)

![笑哭 [笑哭]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot39.png)

![加油 [加油]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot12.png)

![加油 [加油]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot12.png)

![加油 [加油]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot12.png)

![强壮 [强壮]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot59.png)

![强壮 [强壮]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot59.png)

![强壮 [强壮]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot59.png)

2025年,人工智能(AI)发展趋势向好,国产大模型有望再出爆款。武超则预计,随着大模型能力快速迭代,多模型、多模态、易用性将大幅提升。国内大模型表现亮眼,推理价格大幅下降,同时调用量快速提升。算力需求不断提升,国产算力发展的难点主要在图形渲染的民用部分和AI计算的智算中心建设。国内AI应用爆款将密集出现,如广告、视频、AI搜索等。数字经济进入智能时代,AI不仅是加速数字化应用落地的现象级工具,也是数字化时代的“操作系统”和“新引擎”。![加油 [加油]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot12.png)

![加油 [加油]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot12.png)

![加油 [加油]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot12.png)

![强壮 [强壮]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot59.png)

![强壮 [强壮]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot59.png)

![强壮 [强壮]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot59.png)

普及化!平民化的AI。

将成为未来生活中的水与电!![色 [色]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot16.png)

![色 [色]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot16.png)

![色 [色]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot16.png)

![笑哭 [笑哭]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot39.png)

![笑哭 [笑哭]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot39.png)

![笑哭 [笑哭]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot39.png)

![加油 [加油]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot12.png)

![加油 [加油]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot12.png)

![加油 [加油]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot12.png)

![强壮 [强壮]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot59.png)

![强壮 [强壮]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot59.png)

![强壮 [强壮]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot59.png)

复旦大学副教授郑骁庆谈DeepSeek:AI行业不只有“规模法则” 开源将加速模型更新 芯片需求可能不降反增!!!![色 [色]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot16.png)

![滴汗 [滴汗]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot7.png)

![捂脸 [捂脸]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot42.png)

![捂脸 [捂脸]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot42.png)

![捂脸 [捂脸]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot42.png)

![加油 [加油]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot12.png)

![加油 [加油]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot12.png)

![加油 [加油]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot12.png)

![强壮 [强壮]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot59.png)

![强壮 [强壮]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot59.png)

![强壮 [强壮]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot59.png)

DeepSeek的研究表明,很多中小企业都能用得起这样的大模型。尽管训练成本的下降可能会暂时减少对GPU的需求,但大模型变得更加经济,会使原本因为模型成本太高而不打算使用大模型的企业,加入到使用模型的行列,反而会增加对于芯片的需求。

NBD:随着DeepSeek-V3、R1等低成本大模型的问世,传统的大规模数据中心和高投入的大模型训练是否仍然值得继续推进呢?

郑骁庆:我觉得仍然值得。因为首先DeepSeek模型是语言模型,还没有扩展到多模态,甚至于我们以后要研究世界模型。那么一旦引入多模态之后,对算力的要求和基础设施要求就会成指数的增长。因为人工智能不可能仅仅局限于语言体本身,语言只是智慧的一种表现,而在这方面的探索仍然需要这样的一个基础设施。

刚才也提到DeepSeek其实是在很多先期研究的基础之上,找到了一条性能和成本平衡的一个解决方案。先期研究包括各种各样的尝试,怎样去加速它呢?这个还是需要强大的硬件支持。否则,每迭代一次,就可能需要长达一年多的时间,这显然是无法赶上现在AI军备竞赛的。而如果有几万张卡,迭代可能几天就完成了。

另外就是应用方面。即便是模型的推理成本再低,当需要支持数千、数万甚至更大规模的并发使用时,仍然需要一个配备大量显卡的强大基础架构来确保稳定运行。

我觉得大规模预训练这一波潮流可能会弱化,可能不会成为下一步大家争夺的主战场。之前这个领域曾是竞争激烈的战场,但现在看来,成本和产出之间的比例正逐渐趋于紧缩。但是后面两步——高质量数据的微调和基于强化学习的人类偏好对齐,我相信未来会有更多的投入。![色 [色]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot16.png)

![加油 [加油]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot12.png)

![加油 [加油]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot12.png)

![加油 [加油]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot12.png)

![强壮 [强壮]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot59.png)

![强壮 [强壮]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot59.png)

![强壮 [强壮]](http://gbfek.dfcfw.com/face/emot_default_28x28/emot59.png)

本文作者可以追加内容哦 !

百度Ai搜索结果:

DeepSeek对光模块行业带来了增长。

DeepSeek模型的低成本化有助于扩大AI技术的应用场景,进而增加全球数据中心的建设量。光模块作为数据中心互连的关键组件,将受益于高速数据传输的需求增长。具体来说, DeepSeek模型降低了AI训练成本,使得更多企业和机构能够投身AI领域,...[展开]

微信AI搜索结果:

DeepSeek对光模块行业的影响是双重的,既包含短期的负面影响,也可能带来长期的增长机遇。

短期影响:

DeepSeek通过降低算力需求,可能会减缓数据中心等算力基础设施的大规模扩张,这在一定程度上可能抑制了铜缆在短距离连接场景下以及光模块因算力扩张和算力提升而带来的需求增长。...[展开]

重点:

那么一旦引入多模态之后,对算力的要求和基础设施要求就会成指数的增长。

那么一旦引入多模态之后,对算力的要求和基础设施要求就会成指数的增长。

NBD:随着DeepSeek-V3、R1等低成本大模型的问世,传统的大规模数据中心和高投入的大模型训练是否仍然值得继续推进呢?

郑骁庆:我觉得仍然值得。因...[展开]