2025年3月13日,在第三届具身智能机器人产业发展论坛上,浙江人形机器人创新中心首席科学家、浙江大学求是特聘教授熊蓉谈到,机器人智能操作的演变经历了从简单的抓放到高精度作业的显著飞跃,这一进步得益于大模型的融合应用,极大地提升了机器人的行为规划与决策能力。

随着数据驱动技术的不断进步,机器人正逐步从感知智能向行为智能转变,这一转变过程中,接触交互的重要性愈发凸显。然而,数据获取与应用仍是当前面临的主要挑战,数据稀缺成为制约发展的关键瓶颈。为了应对这一挑战,人工遥控采集和合成数据生成成为常用的数据获取手段。但遥控采集对设备的实时性和操作人员的经验提出了高要求,导致成本高昂;而合成数据虽然在视觉渲染方面取得了较为成熟的成果,但在接触仿真方面仍存在明显不足。

在技术方法层面,大模型虽然具备一定的通用性,但在准确性方面仍有待提升,尤其是在机器人行为的高精度、高可靠性和高效率要求下,这一不足尤为明显。此外,机器学习领域也面临着可解释性差、灾难性遗忘等亟待解决的问题,亟需进一步优化。

尽管面临诸多挑战,但当前人形机器人、大动作模型和空间智能等技术正处于产业起步阶段,资本和研究投入十分活跃。

熊 蓉 | 浙江人形机器人创新中心首席科学家、浙江大学求是特聘教授

以下为演讲内容整理:

具身智能操作发展概述

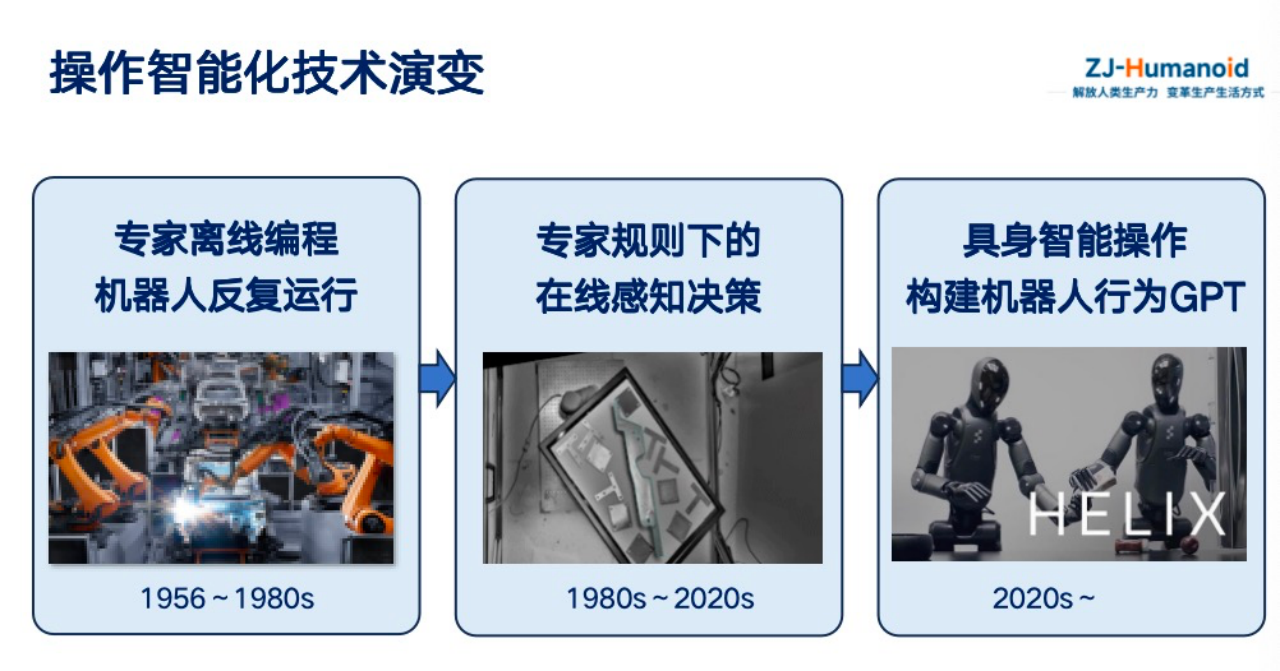

在机器人领域的发展进程中,操作能力始终是其关键的基础功能。从机器人诞生之初,追求操作的通用性便成为行业的核心目标。早期,机器人主要通过专家离线编程实现反复执行,在工业场景中凭借高精度、高效率和高负载的优势发挥了重要作用。但随着应用场景的不断拓展,工业场景中的加工部件频繁变化,且诸多非工业场景难以像工业环境那样进行预设和定义,促使技术不断演进。

图源:浙江人形机器人创新中心

20世纪80年代,伴随机器视觉技术的兴起,基于专家规则的在线感知及伺服控制应运而生,为制造业发展注入新动力。如今,具身智能操作成为研究的新焦点。在计算机领域,从2011年起,就开始采用数据驱动的方式提升智能的可泛化性,具身智能被定义为具备感知推理能力且能与物理世界互动的智能系统。在自动化和机器人领域,图灵对智能的定义影响深远,此前依靠机理建模和专家经验解决问题,如今借助人工智能技术,可通过环境交互获取数据来学习操作。

早在2016年,谷歌就利用16台机器人历经6个月的训练,使其学会抓取操作。此后,UC伯克利等机构不断融合学习技术,推动具身智能从简单的抓放操作向高精度作业等更多复杂行为拓展。大模型在机器人操作智能的行为规划和决策方面发挥了重要作用,然而在动作轨迹和控制涉及的力觉等信息处理上仍存在不足,如何构建和应用数据提升接触交互的智能性成为当下研究的关键问题。

具身智能操作发展面临的挑战

具身智能操作在发展过程中面临诸多挑战。数据方面,数据匮乏是主要问题。目前获取数据的常见方式包括遥控采集和合成数据。遥控采集对设备实时性和操作人员经验要求颇高,特斯拉为获取高质量数据提供高薪,却也凸显了高昂的成本。合成数据虽有视觉渲染技术支持,但在接触仿真方面仍较为薄弱。例如,常用的英伟达Isaac Sim仿真平台,在处理多刚体运动时,与真实场景存在差距,对操作中力觉信息的仿真支持不足,难以满足学习训练需求。即便像海耐基梅隆大学联合多院校推出的Genesis,在接触仿真性能上也无法达到应用要求。

图源:浙江人形机器人创新中心

方法层面,尽管大模型发展迅速,但通用性和准确性难以平衡。对于机器人行为而言,任何差错都可能在工业生产中引发事故,在服务场景中危及人机安全。机器学习自身也面临可解释性差、灾难性遗忘等问题,如何在确保泛化性的同时实现高精度、高可靠和高效率,是亟待解决的难题。

执行体性能同样有待提升。在接触作业中,力觉传感器、端侧智能计算控制器和操作末端灵巧手等执行体组件,目前的性能无法充分满足具身智能操作的需求,限制了技术的进一步发展和应用。

团队研究成果与应用

浙江大学熊蓉团队在机器人领域开展了长期且深入的研究工作。自2000年起,团队聚焦机器人智能融合,探索机器人从封闭受控环境向开放环境的智能移动和作业。2012年起,致力于减少人工编程依赖,推动机器人自主学习。

在人形机器人研究方面成果丰硕,研发出多类型人形机器人。如多次荣获国内冠军、4次获得国际亚军的足球机器人;在国家863重点项目支持下,研制出能与人或双机器人进行乒乓球对打的悟空一代,对打回合数达100多个;还成功开发出室内外快速稳定行走的双足机器人,并在操作领域取得进展,涵盖未知混杂情况下的位置估计、多行为决策及工业应用。

2023年12月,团队注册成立浙江人形机器人创新中心有限公司,专注于人形机器人与具身智能的融合,打造相关产品和应用工具链。2022年3月和8月分别发布领航者1号和领航者2号样机。前者实现长距离稳定行走和全身协调舞蹈;后者身高提升至1米65,更适配人类作业环境,解决了双手协同操作、使用工具和全身协同行走等问题。

图源:浙江人形机器人创新中心

在操作技术研究上,团队探索出一套独特的方法。在感知层,针对大模型在物体检测和位置估计方面的不足,采用Real2SimReal等方法,通过对物体进行高保真重构、在仿真场景渲染图像并应用于实际,有效提升检测精度,在非透明和透明物体检测中均得到验证。在行为层,早在2012年就研究将人类操作行为转化为机器人程序,解决视觉观测误差与机器人执行精度的差异问题,实现多种装配作业。2022年,将抓取操作与语言视觉大模型联合建模,使其能在混杂场景下完成复杂作业,并构建面向目标的长序列行为生成机制,应对复杂任务要求。

在动作层,致力于实现拟人化动作,提出动态图神经网络方法学习长序列动作映射,保障人机动作相似性、机器人可执行性和安全性。目前,已实现将人类动作数据快速部署到机器人上,并解决了人形机器人站立作业和全身行走的技术难题,还能实现边走边挥手等交互动作,未来将进一步提升稳定性和拟人化程度。

在底层控制方面,团队将视觉伺服控制与学习方法融合,解决了传统方法需人工定义特征和收敛慢的问题,使其能适应多种物体和操作场景,无需相机标定即可完成作业。同时,构建基础历史模型,提升控制的泛化能力,在华为生产线的充电插拔和光模块插板等操作中,精度、学习效率和成功率均超越传统方法。此外,团队还将力觉信息融合应用于服装制造的柔性布料上下料和PCB柔性毛刷抓取等领域,显著提升了自动化水平,缩短了部署和测试优化时间。

(以上内容来自浙江人形机器人创新中心首席科学家、浙江大学求是特聘教授熊蓉于2025年3月13日在第三届具身智能机器人产业发展论坛发表的《具身智能操作发展挑战与进展》主题演讲。)

本文作者可以追加内容哦 !