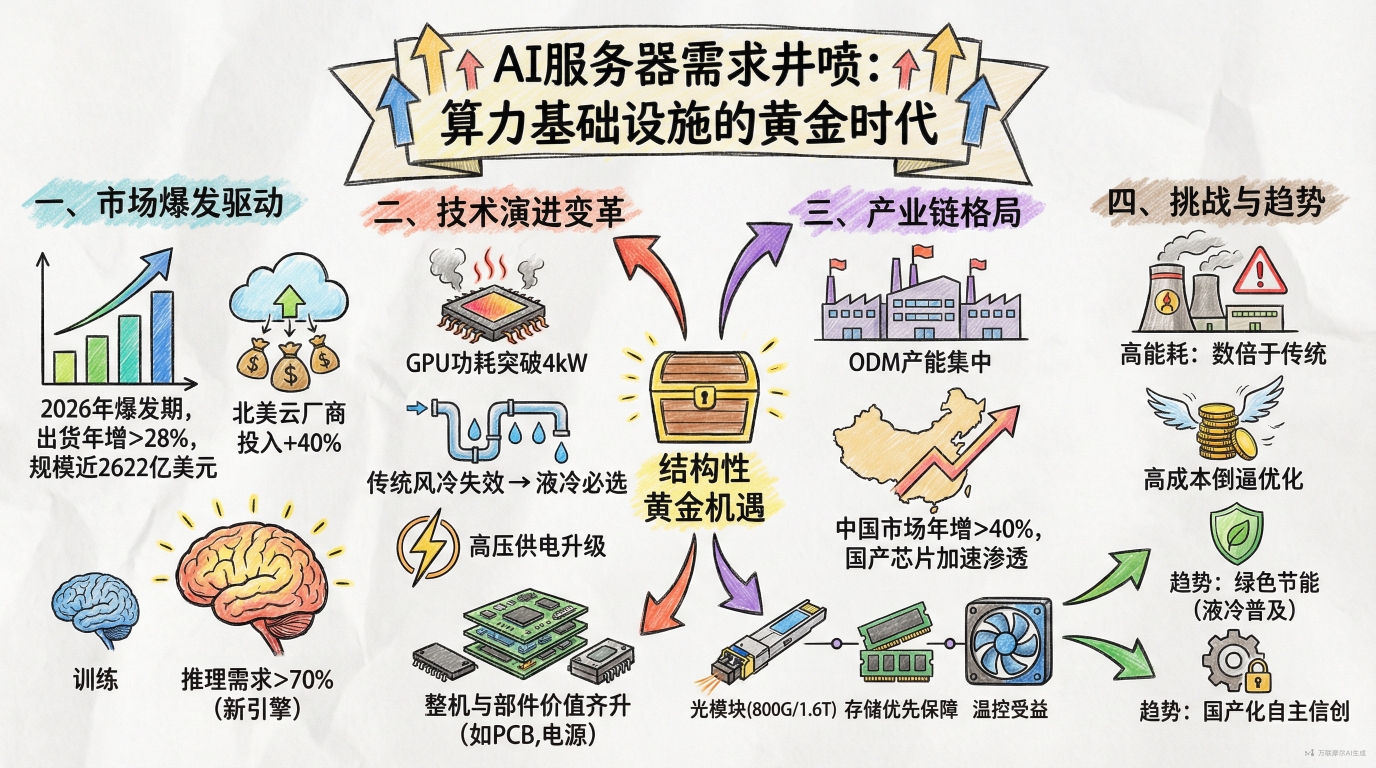

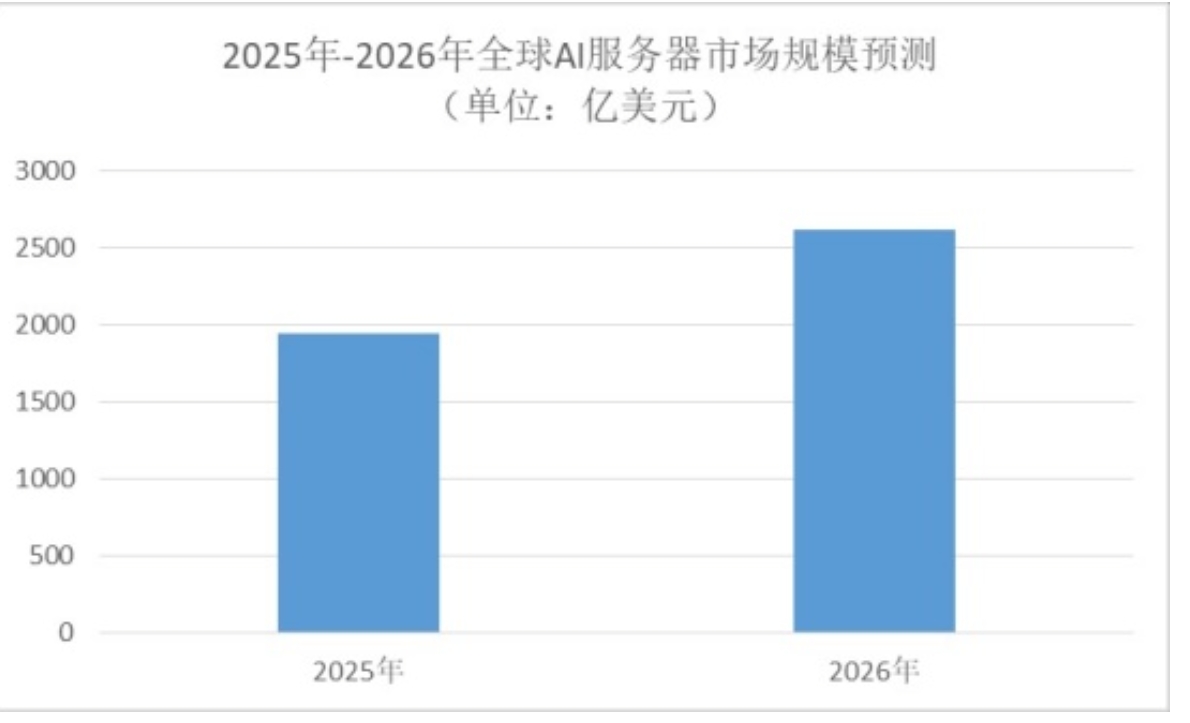

说实话,2026年的AI算力市场,已经不能用“增长”来形容了,更像是“井喷”。

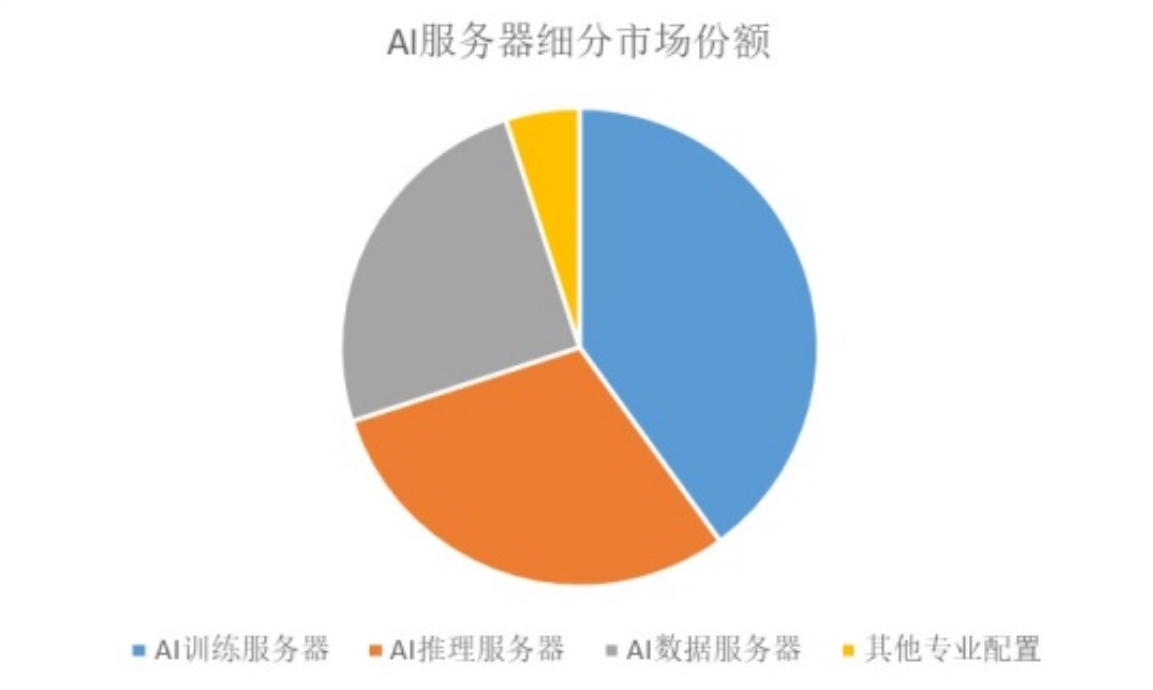

全球AI服务器出货量预计同比增长超28%,总量突破320万台。北美五大云厂商的资本支出年增率高达40%,合计超过6000亿美元,绝大部分砸向了AI基础设施。更关键的是,推理算力需求已经占到整体AI算力消耗的70%以上——这意味着算力需求从“阶段性高峰”变成了“持续性刚需”,每一次用户和AI的交互,背后都是实打实的服务器在运转。

一、需求逻辑变了:从训练单轮驱动,到推理接棒增长

以前大家盯着大模型训练,觉得训练完了就没啥事了。但现在不一样了,应用落地催生出海量推理请求,通用型服务器也同步进入替换周期。2026年全球整体服务器出货量预计年增12.8%,这个增速在传统服务器领域已经很久没见过了。

所以,算力基础设施厂商面对的,不是一个短期的“订单脉冲”,而是一轮持续数年的建设周期。这个判断,比单纯看某一家公司的订单更重要。

二、技术升级:单机价值量被重新定义

这一轮AI服务器的另一个特点,是“变贵了”。

GPU最大TDP将突破3700W,传统风冷彻底失效,液冷成了唯一可行路径。英伟达GB300的液冷组件单价近5万美元,比上一代提升了约20%。供电方案也在重构,从12V向48V/800V直流母线迁移,单柜电源方案价值可能翻十倍。PCB层数普遍达到44-46层,高端HDI板价格成倍增长。

这意味着,产业链上那些能跟上技术迭代的厂商,单机价值量在显著提升,而不是靠“量”堆出来的增长。

三、产业链格局:谁在真正受益?

从整机看,鸿海、广达、纬创等ODM巨头占据主导,但上游核心零部件的国产替代也在加速。

1、光模块方面,800G出货翻番,1.6T进入量产,CPO技术开始落地;

2、存储芯片方面,HBM、DDR5、企业级SSD优先保障AI服务器,产能挤占效应明显;

3、温控方面,英维克、高澜股份等液冷方案订单随算力建设高增。

国内AI服务器市场规模预计2026年达3500亿元,同比增长超40%。国产芯片生态也在成熟,鲲鹏、昇腾、海光等平台加速渗透政务、金融等领域。

像华勤技术这类具备平台化布局能力的厂商,数据中心业务2025年营收已突破400亿元,交换机倍数增长,说明产业链的受益已经从“单点”向“全栈”扩散。能在服务器、交换机、散热、供电多个环节协同的厂商,抗周期能力和成长确定性更强。

当然,挑战也在。

能耗是硬约束,1GW集群年耗电约7000GWh,硬件成本占云厂商投入超60%。这也倒逼行业往液冷普及、全栈协同、国产化自主三个方向演进。

总体来看,算力基础设施正处在结构性机遇期。从整机到零部件,从散热到供电,这条产业链的景气度,不是“炒概念”,而是实打实的订单和业绩在推动。

(注:以上仅为个人观点,不构成投资建议。股市有风险,投资需谨慎。)

#算力链集体发力:CPO、PCB、存储等大涨# $云计算(BK0579)$ #【有奖】AI服务器需求井喷,算力基础设施厂商的黄金时代来了?# #社区牛人计划# #AI算力引爆变压器荒,订单排到2027年# $电网设备(BK0457)$ @东方财富创作小助手 @股吧话题 $华勤技术(SH603296)$

本文作者可以追加内容哦 !