昨天腾讯理财通接入DeepSeek-R1时,我还发短评说腾讯本周连续四天都有AI 方面的动作,有点期待今天的好消息了。

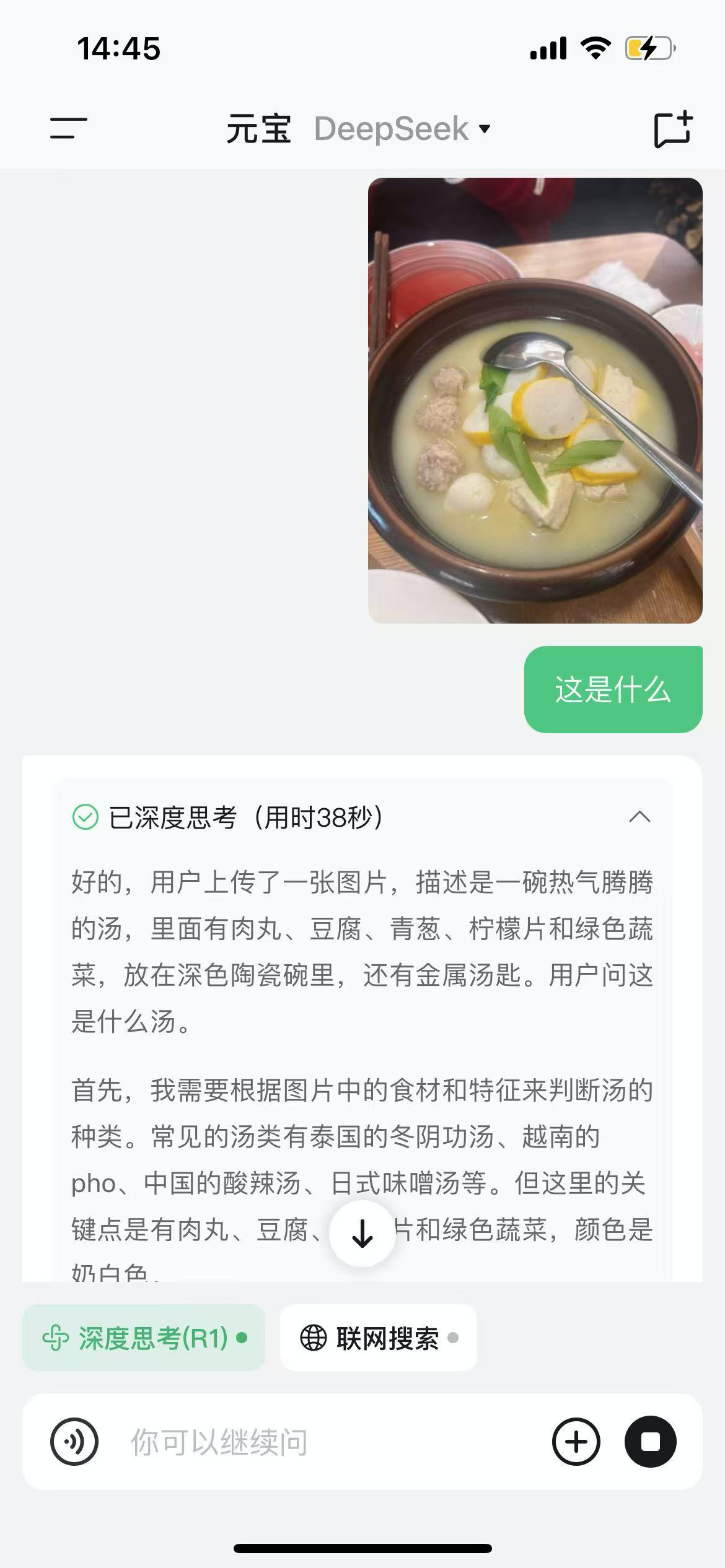

果不其然,今天上午腾讯元宝就上线了全新的图生文功能。按照官方说法就是,你上传一张图片,元宝不仅能识别其中的文字,还能理解画面内容,并给出自己的分析和解读。

起初,我心里还犯嘀咕:让大模型看图说话,能有多难?

在我上传同一张美食图问DeepSeek和腾讯元宝“这是什么”后,这一对比,差距就出来了。DeepSeek目前还只能识别文字,面对这张没有文字的美食图,它只能给出 “未提取到名字” 的反馈。

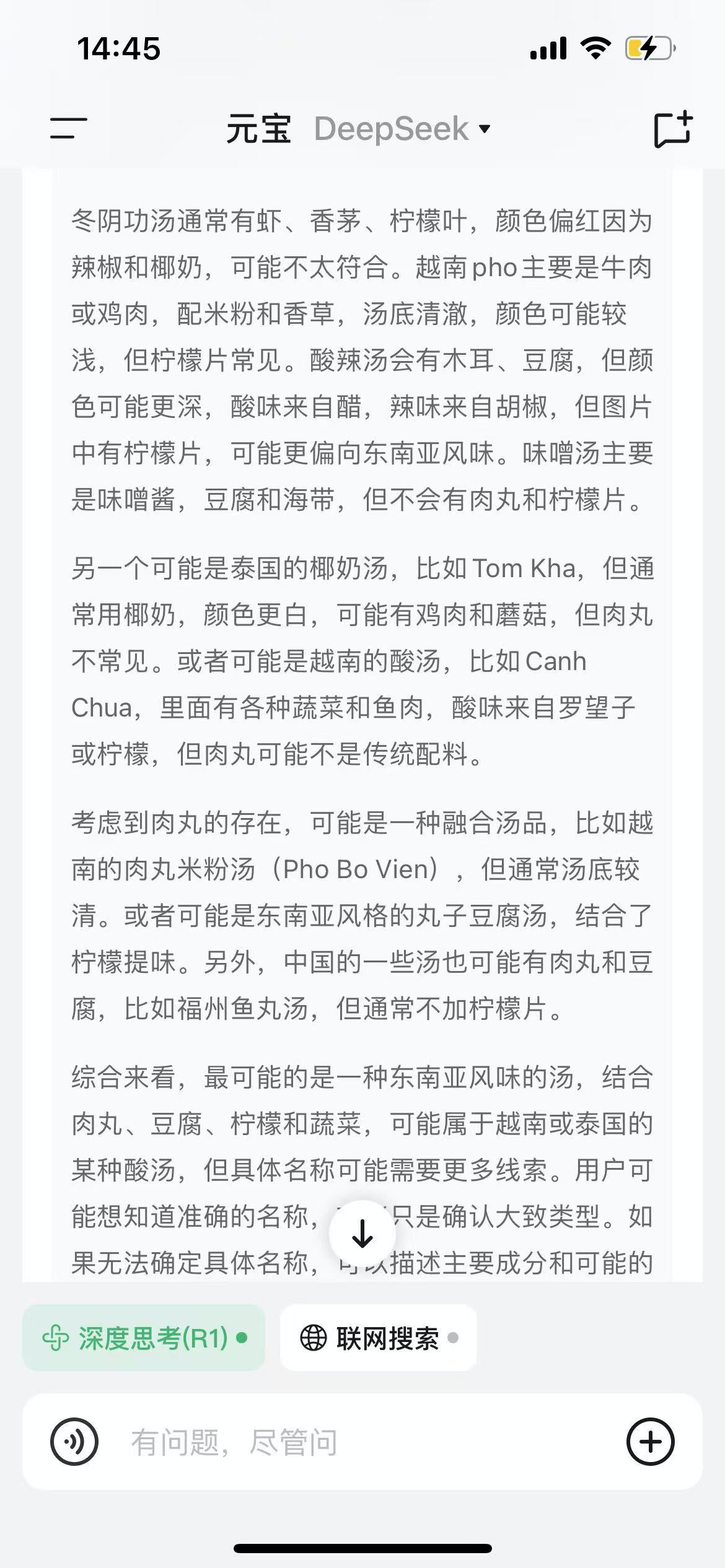

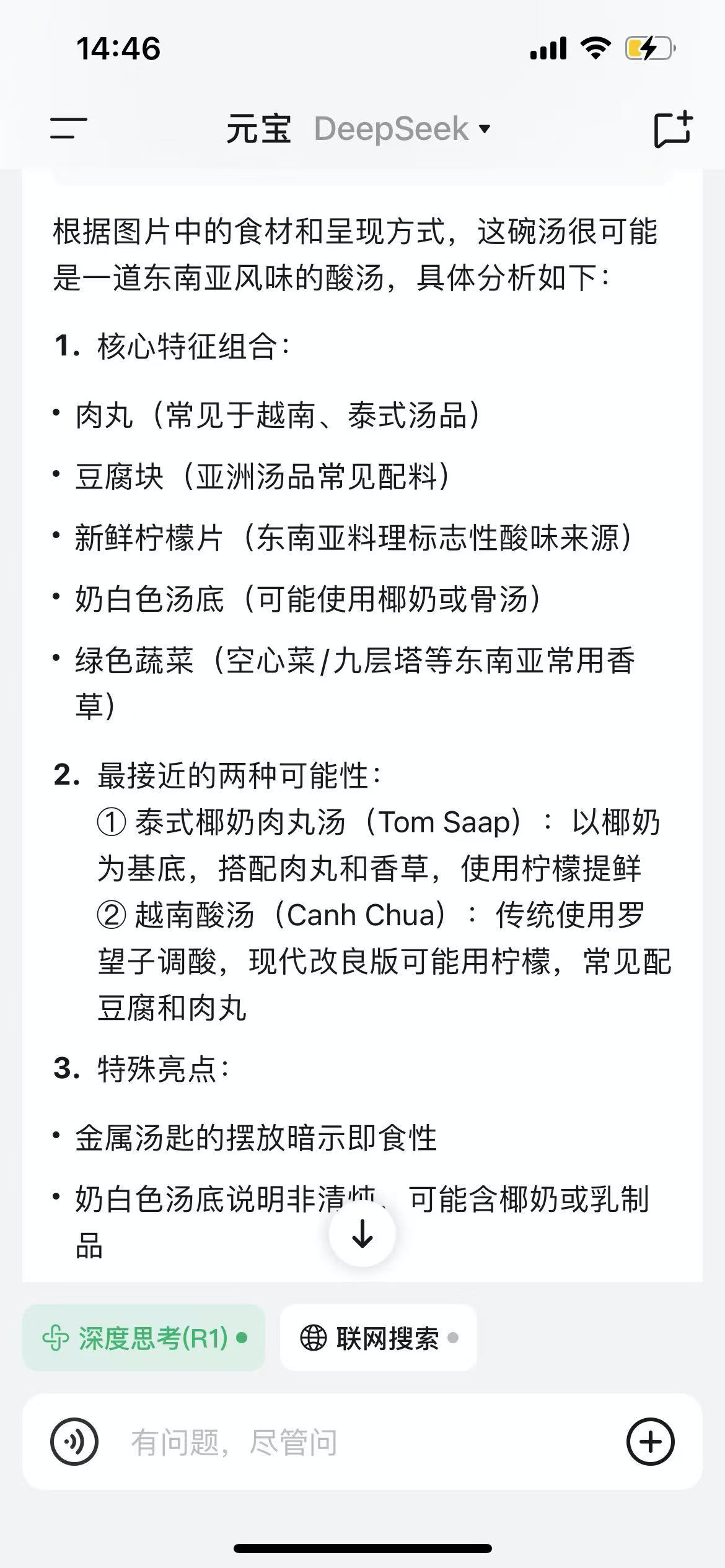

再来看了腾讯元宝DeepSeek38秒的思考过程:

它先根据图片中的食材和特征先判断出汤的种类,然后罗列出各种汤的种类,并详细介绍了各种汤的特点。

然后就这碗汤到底出自哪国给出了详尽的思考分析,最后综合各种分析后,得出这碗汤可能是东南亚风味,并给出具体分析。

我对这个结果还是挺满意的,有兴趣的也可以上传图片亲自体验一下。

不过有一点需要注意,使用元宝DeepSeek的看图说话功能时,得先关闭联网搜索。

为什么腾讯元宝可以做到看图说话?我还专门去研究了下,原来元宝DeepSeek之所以能看得懂图片,是因为腾讯混元大模型技术底座支持AI原生应用腾讯元宝,使其具备多模态理解能力,准确识别图像元素、理解其关系,加之DeepSeek的深度思考能力,“双模型“结合起来,图像识别的精确度及语言描述能力自然就“buff叠满”。

其实,自2月13日腾讯元宝接入DeepSeek-R1满血版后,就一直在做迭代和功能更新,几乎每两天就会有行动出来,大鹅这速度也没谁了。

目前来看,随着腾讯元宝的一系列迭代和功能更新,元宝内的所有模型都支持理解图片、解析文件、联网搜索公众号,还能直接从微信上传文件,功能越来越强大。

再考虑到腾讯多款产品不同产品属性的产品都已经接入DeepSeek,比如代表知识库的ima,

、金融数据提纯平台理财通、文档工具腾讯文档、搜索工具微信、QQ浏览器 ……哎麻,不敢想,腾讯这是被AI包围了。

我看还有人把马化腾在2023年股东大会上说的一句话拿出来“揶揄“腾讯在AI上不够积极,他当时说 “对于工业革命来讲,早一个月把电灯泡拿出来不那么重要的” 。但其实马化腾后面还有一句话,“关键还是要把底层的算法、算力和数据扎扎实实做好,而且更关键的是场景落地”。

现在再回过头来看腾讯,与其说人家不是不重视,相反,它对待 AI 大模型的态度更加谨慎。

结果我们也看到了,尽管腾讯的生态很复杂,但在DeepSeek出来后,它却能在短期内就让旗下各种场景下的产品快速接入DeepSeek这样的推理模型,并做到较好的适配,归根结底在于人家“地基”打得好,一旦合适的机会到来,腾讯就能迅速接住。

其实长期跟踪腾讯的都知道,它做事向来有自己的节奏。我觉得这样挺好的,不人云亦云,跟着自己的节奏走,接下来有点期待腾讯AI接下来的动作了!

本文作者可以追加内容哦 !